AWS CLIでファイルをS3へアップロード

AWS CLIでファイルをS3へアップロード クラウドストレージへのファイルアップロードは、現代のシステム開発において欠かせない作業の一つです。特にAmazon S3はその高い信頼性と豊富な機能により、多くのプロジェクト […]

Filter by Category

AWS CLIでファイルをS3へアップロード クラウドストレージへのファイルアップロードは、現代のシステム開発において欠かせない作業の一つです。特にAmazon S3はその高い信頼性と豊富な機能により、多くのプロジェクト […]

GitHub Actionsで Lambdaにデプロイ失敗した原因を調査 GitHub ActionsでLambdaへデプロイ中に発生したエラーを調査し、適切なポリシーの追加と deploy.ymlへのコマンド追加で解消 […]

GitHub ActionsでAWS Lambdaに自動デプロイ DevOpsの実践において、CI / CD(継続的インテグレーション / 継続的デリバリー)は欠かせない要素となっています。特に、クラウドサービスを活用し […]

Pythonのコマンドラインで特定の関数のみを指定して実行する AWS Lambdaではプログラム実行時に関数を指定しますが、pythonコマンドは通常、ファイル単位で指定するのでそのままでは実行できません。そのためロー […]

CodePipelineでCodeBuildのテストを自動化 CodeCommitで管理しているリポジトリをCodeBuildでテストする場合は通常、手動でテストを実行させる必要がありますが、CodePipelineを使 […]

AWS CodeCommitでプルリクエスト・マージ ソースコードの管理にはGitHubやGitLabを採用している方が多いかもしれませんが、AWSにもCodeCommitというサービスがあり、5人までは無料で5人以上で […]

AWS LambdaとS3、SNSでファイルのアップロードを自動通知 AWS Lambdaは特定の条件を満たすときにサーバーレスでPython(他のプログラミング言語も)を実行できるサービスです。トリガーを検知したときや […]

Amazon Route 53で新規ドメインを登録 ウェブサイトやウェブサービスを運営する際にドメインは欠かせない要素です。この記事では、Amazon Route 53で新しいドメインを登録する方法について解説します。 […]

S3のライフサイクルルールの落とし穴 保存したデータが必要以上に増えないようにライフサイクルルールで指定した日数を経過したデータは削除する設定にしていましたが、後日改めてバケットを確認するとフォルダ、ファイルどちらも削除 […]

S3でストレージクラスを一括で変更 デフォルトではS3のストレージクラスは「標準」になっていますが、このストレージクラスは頻繁にアクセスするデータを保存するのに適した設定なので、バックアップファイルなどの頻繁にアクセスし […]

AWS Rekognitionとは AWS Rekognitionは、画像と動画から情報を抽出するディープラーニング技術を利用した分析サービスです。このサービスは、顔認識、物体検出、シーン分析など、さまざまな分析機能を提 […]

AWS Cloud9にPython3.9をインストール AWSのCloud9(Ubuntu)にはデフォルトでPython 3.6.9がインストールされています。 openaiに必要なpandasのインストール opena […]

AWSのCloud9を使ってPythonのプログラミング研修を開催 2022年11月から2023年2月までの期間で、群馬県庁職員を対象にしたDXを促進するためのPythonによるプログラミング研修を開催しました。現在、群 […]

AWSで追加したユーザのMFAに1Passwordを設定 AWSのコンソールにログインする際にMFA(Multi-Factor Authentication)という多要素認証を設定することで、メールアドレスとパスワードに […]

AWS Deep Learning AMIを用いたGPU環境構築の手順 今回はCUDAやcuDNN等の環境が予め構築されていて機械学習に適したインスタンスをかんたんに作成できるAWS Deep Learning AMIを […]

データベースのバックアップファイルをAWSのS3に保存するプログラムを手動で叩くと問題なくS3にファイルが保存されるのに、cronで定期的に実行したらエラーが出るようになったので調べた内容です。原因はPythonのパスが […]

クラウドストレージへのファイルアップロードは、現代のシステム開発において欠かせない作業の一つです。特にAmazon S3はその高い信頼性と豊富な機能により、多くのプロジェクトでストレージ基盤として採用されています。コマンドラインから操作できるAWS CLIを使えば、ファイルのアップロードを自動化したりバッチ処理に組み込んだりすることも容易です。今回はAWS CLIを使ってS3へファイルをアップロードする基本的な方法を解説します。

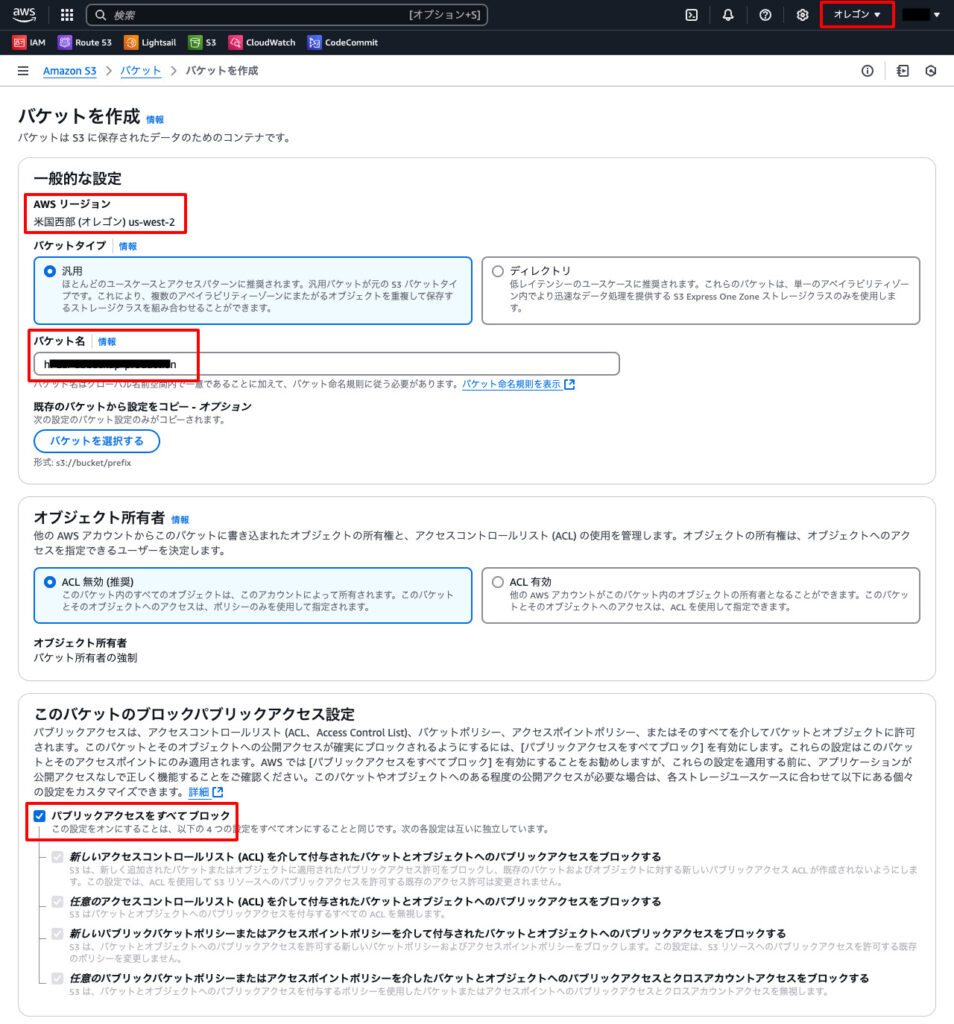

初めにファイルのアップロード先となるバケットを作成します。赤枠内の設定の確認と任意のバケット名を入力して「バケットを作成」を押下します。

S3へのアップロード権限を持つユーザーを作成します。ユーザー名を入力して「次へ」を押下します。

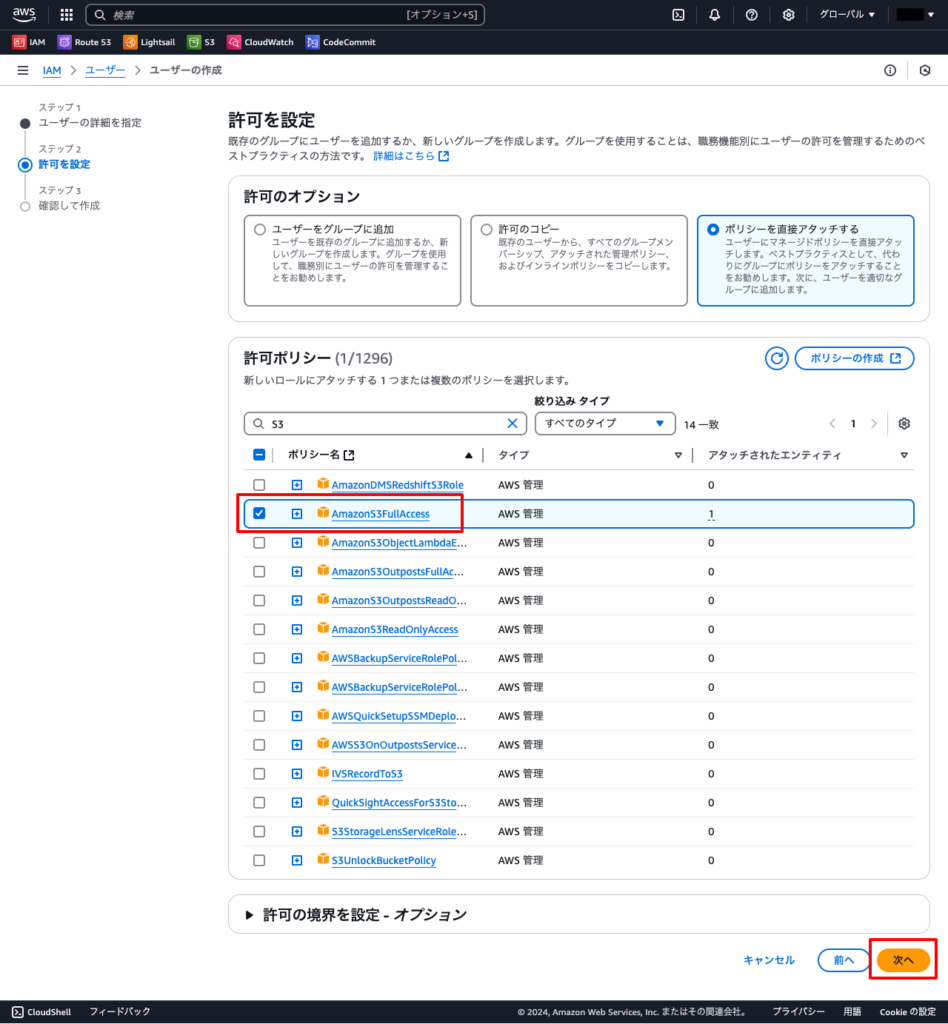

作成したユーザーにポリシーをアタッチします。今回はS3の操作のみを許可するユーザーなので、AmazonS3FullAccessにチェックを入れて「次へ」を押下します。

内容を確認して問題なければ「ユーザーの作成」を押下してユーザーを作成します。

「アクセスキーを作成」を押下してAWS CLIの設定に必要なアクセスキーを作成します。

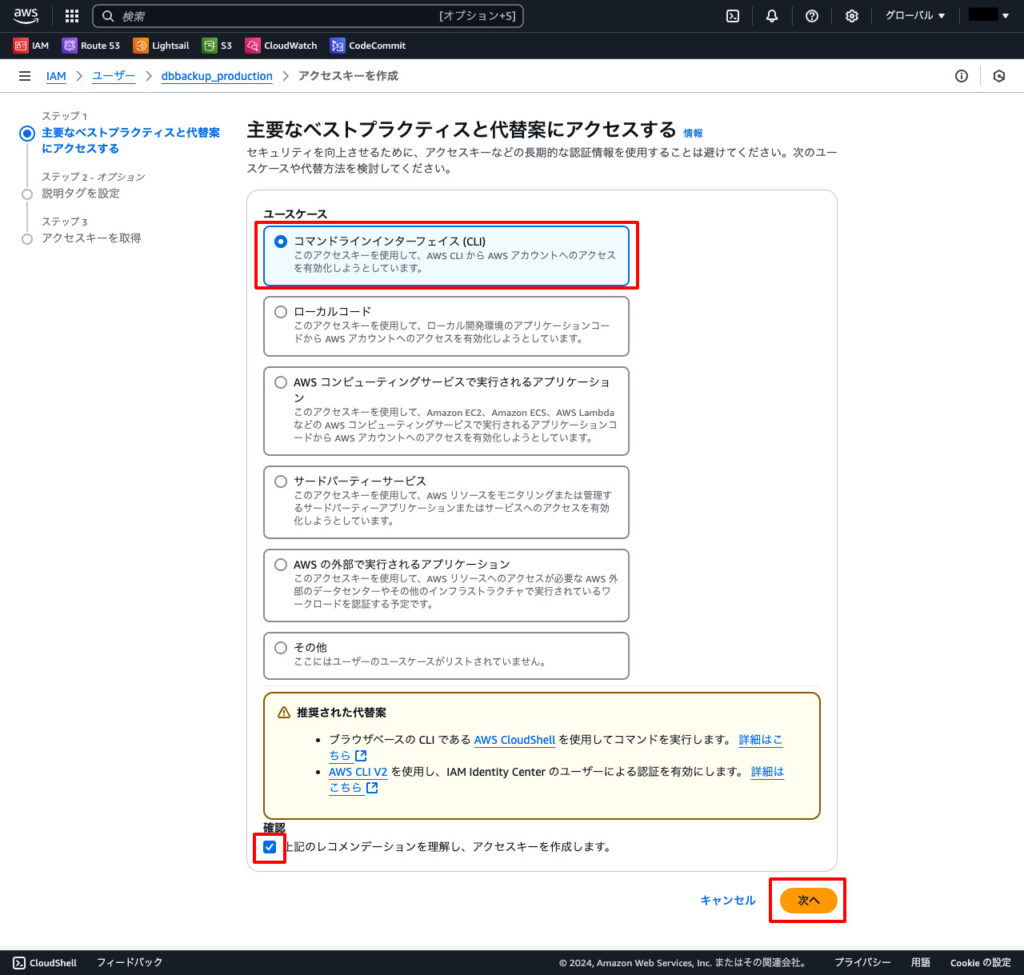

赤枠内にチェックを入れて「次へ」押下します。

説明タグはオプションなので今回は未入力のまま「アクセスキーを作成」を押下して進みます。

S3バケットとIAMユーザーの作成が完了しました。

初めにパッケージの解凍に必要なunzipをインストールします。

sudo apt install unzip下記コマンドを実行してaws cliをインストールします。

curl "<https://awscli.amazonaws.com/awscli-exe-linux-x86_64.zip>" -o "awscliv2.zip"

unzip awscliv2.zip

sudo ./aws/installインストールしたバージョンはaws --versionで確認できます。

aws-cli/2.22.4 Python/3.12.6 Linux/6.2.0-1018-aws exe/x86_64.ubuntu.22aws configureを実行してアクセスキー情報を設定します。

AWS Access Key ID [None]: ACCESSKEYID

AWS Secret Access Key [None]: SECRETACCESSKEY

Default region name [None]: us-west-2

Default output format [None]:ACCESSKEYID, SECRETACCESSKEY:IAMユーザー登録時にダウンロードしたdbbackup_production_accessKeys.csvの値us-west-2:バケットを作成したリージョン設定した情報はcat .aws/credentials、cat ~/.aws/configで確認できます。

cat .aws/credentials

[default]

aws_access_key_id = ACCESSKEYID

aws_secret_access_key = SECRETACCESSKEYcat ~/.aws/config

[default]

region = us-west-2インストールが完了したらascliv2.zipを削除します。

rm -rf awscliv2.zipS3へファイルをアップロードするには下記コマンドを実行します。

aws s3 cp FILENAME s3://BUCKETNAME/FILENAME:S3にアップロードするファイル名(拡張子含む)BUCKETNAME:作成したバケット名指定したバケットにファイルがアップロードされていることが確認できたら完了です。

群馬県でPythonを使ったAIやソフトウェアを開発している株式会社ファントムが運営しています。